我買美股很多年了,也去過華爾街幾次。不過最近開始考慮遺產稅的問題,決定把錢從 Firstrade 搬到盈透 (IBKR),改買愛爾蘭版的股票。愛爾蘭聽起來就很陌生,我還沒有去過。另外,盈透的 APP 一看就很難用;這些在在都拖慢了我的執行速度。

雖然 Firtrade 我用得很習慣,但是它只能買美股。在我的投資組合當中,只有債券和 SHEL (註冊在英國) 是免遺產稅的,主力的 QQQ 這些 ETF 都要課稅。在美國投資的外國人免稅額才 6 萬美金,超過一百萬還要課 40% 的累進稅率。與其等我掛了才跟我家收這筆錢,我還不如先拿去換川普金卡。(诶?另類思考)

總之,註冊在愛爾蘭的 QQQ、Nasdaq 100 – CNDX (ISIN代碼:IE0006521712 ) ,即使在美國券商買,也不用課遺產稅;還不用預扣 30% 的股息稅,只要扣 15%。沖著這兩個主要優勢,即使管理費變高了。我還是狠下心來決定搬家。

| ETF 代號 | 發行商 | 管理費 | 類型 / 註冊地 | 配息方式 |

|---|---|---|---|---|

| QQQM | Invesco (景順) | 0.15% | 美國 ETF | 季配息 |

| QQQ | Invesco (景順) | 0.20% | 美國 ETF | 季配息 |

| CNDX | iShares (安碩) | 0.33% | 英國/愛爾蘭 (UCITS) | 累積型 (股息自動再投資) |

因為 Google 搜尋並不算是很良心的企業,我怕要是點到釣魚網站或是下錯 APP,身家財產可能就少一塊了。所以我仔細核對了好幾次,確定點到正牌的盈透帳戶,而不是盈立什麼的。APP 也有下載對,連上的網站確實可以互相認證才放心。此外,網路上有很多教學也幫了我的忙,特別是 “Caven 投資成長家", 我看了兩三次。大陸人也有很多教學,只是不太合用。

我本來誤以為可以選擇開哪個國家的分行,看到網址自動轉到澳洲就很緊張。其實只要不是香港就行了。台灣人開戶難度很低,在證件方面甚至不需要護照,只需要身分證和自拍就可以搞定。

確定帳戶成功後,再來就要申請轉戶。轉戶有幾個選項,包括要不要全轉?如果有不符合盈透規定的票劵是否確定就留下? 如果一部分不能轉還要不要繼續?雖然感情上有所不捨,我就選了全轉,要是盈透不收某些標的,我選擇讓它留在 Firstrade。

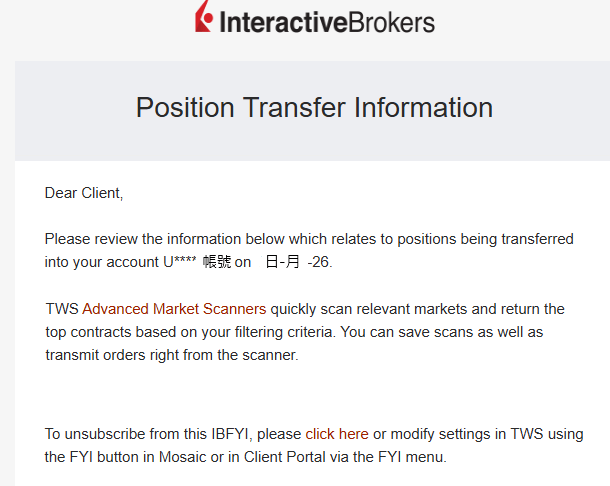

申請送出後,他們寄了一封信給我。大致長這樣。

可能是因為時差,接下來的一天,白天毫無動靜。到了晚上,我看到盈透已經給我錢和一支股票 JEPQ 的整股。當我再回去看 Firstrade,那邊竟然顯示我的資產全部還都在帳上。哇!不但錢沒有變成詐騙集團喜歡的樣子,反而 double 了!?

當然,這是假象。Firstrade 很快修正了餘額,帳上只剩下 JEPQ 的零股,以及一筆美債。正當我以為這就是所謂盈透不喜歡而拋下的資產,過了一夜之後,債券也搬過去了。看來只是處理的速度有差別而已。此時,Firstrade 只剩下 JEPQ 的零股。

喔,原來盈透不收零股啊? 正當我想著如何要靠這 0.96377 股打造出另外一筆大祕寶的時候,Firstrade 竟然主動把 0.96377 股賣了!並且在我的帳戶中留下神秘的 98.67 USD。這數字怎麼來得?我也很疑惑!賣掉還不足一股的 JEPQ,頂多是 60 USD。多出的 38 元又是什麼?

我接著檢查了轉到盈透的現金,一共是少了 56 USD,我把它理解為轉戶要收的過路費。原本我就問 AI 時,它就有講到轉戶費用的事。這範圍我也可以接受。另外,盈透如果開戶時有人介紹,雙方都可以賺錢或是股票,那個錢我也沒有想賺。畢竟從別人貼的 link 點進去申請,我還更怕會出事。

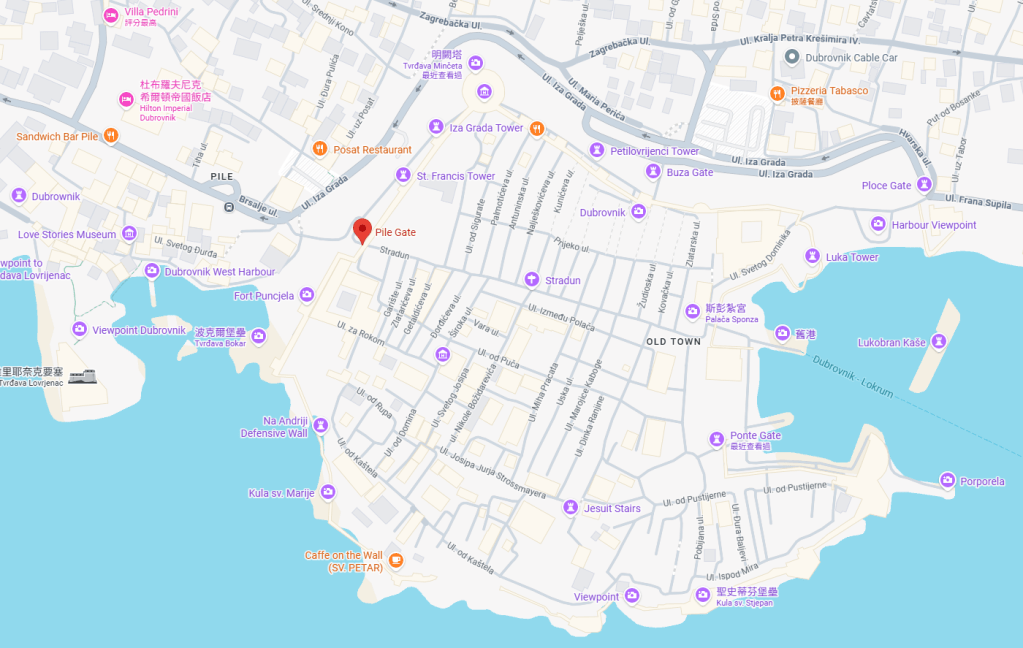

在有點不明不白的狀況下,我終於搬家成功了。下一步當然就是買愛爾蘭版的 QQQ – CNDX。說實在的,IBKR 真的很厲害,可以買到幾乎全世界的商品;但也因為商品太多了,叫他搜個 CNDX,會出來好多筆不同國家、不同標的、代號很相像的股票。

像是美股的 JEPQ,可以對應到歐股的 JEPQ,JEQP,分別在英國、德國,以美元、歐元、英鎊交易發行,只是股價不一樣、交易所的時間也不一樣。這還是同一個標的,有時候一個代號會對到完全不同的標的。我看對了嗎?我買對了嗎?那個感覺真是跟切 Excel 發獎金給好幾個部門一樣緊張。

因為操作太過於繁瑣,我忽然有了一個擺爛的想法。按照盈透存款超過 10 萬美金以上 3.14% 的活存利率,我還買什麼 CNDX?放著領利息不就夠爽了。誒,擺爛雖好,但是這個想法是有毒的,任何一種高股息都比不上買股票讓全世界最厲害的人幫你打工。

即使不想在這個時候 all in CNDX,不能忘記美金也是要收遺產稅的,不買愛爾蘭產品,這次就白搬了。所以至少也要買個 JEPQ.L(ISIN:IE000U9J8HX9) 墊檔。美國都不賣我們武器了,能讓它少賺就少賺~~~